Branchen I USA I Halbleiter

Markt im Umbruch – wem gehört die Zukunft bei den KI-Chips?

Nvidias Vormachtstellung bei den KI-Chips gerät ins Wanken. Der Trend zu spezialisierten Chips macht die Landschaft heterogener und eröffnet deutschen Unternehmen neue Chancen.

10.04.2026

Von Heiko Stumpf | San Francisco

Der Markt für KI‑Chips verspricht außerordentliches Wachstum. "Bis 2030 dürfte die Zahl der weltweiten KI‑Nutzer von derzeit rund einer Milliarde auf etwa fünf Milliarden steigen", sagte AMD‑Chefin Lisa Su auf der CES 2026 in Las Vegas. Der damit verbundene Bedarf an Rechenleistung wächst noch schneller: Die globalen Rechenkapazitäten müssen sich bis 2030 laut Su verhundertfachen – von rund 100 Zetaflops im Jahr 2025 auf mehr als 10 Yottaflops. Ein Yottaflop ist eine Eins mit 24 Nullen.

Entsprechend steigt auch die Nachfrage nach KI‑Chips rasant. AMD schätzt den weltweit adressierbaren Markt für KI‑Beschleuniger bis 2030 auf rund eine Billion US‑Dollar (US) pro Jahr. Dies käme einer Verdoppelung gleich – für 2026 wird das Marktvolumen auf 500 Milliarden US$ geschätzt. Doch für Anbieter wie AMD war es bislang schwer, nennenswerte Marktanteile zu erobern. Der Platzhirsch Nvidia dominiert nach Belieben und hält im lukrativen Segment für KI-Rechenzentren einen Anteil von mehr als 80 Prozent.

Diese Stellung verdankt Nvidia vor allem der Stärke seiner GPU‑Chips, die insbesondere beim Training großer KI‑Modelle eingesetzt werden. Doch nun ändern sich die Spielregeln: Der Markt steht vor tiefgreifenden strukturellen Umbrüchen, die eng miteinander verknüpft sind. Dies dürfte dazu führen, dass Wettbewerber an Boden gewinnen und Nvidia seine Vormachtstellung in einigen Bereichen verliert.

Trend 1: mehr maßgeschneiderte Chips

GPUs wie die von Nvidia sind leistungsstarke Alleskönner und enthalten daher Funktionen, die für spezifische KI‑Anwendungen nicht zwingend erforderlich sind. Entsprechend gewinnen maßgeschneiderte Custom‑Chips – im Fachjargon ASICs – an Bedeutung, die gezielt für einzelne KI‑Workloads optimiert sind.

Vor allem große Technologiekonzerne wie Amazon, Google, Microsoft und Meta treiben diese Entwicklung voran, obwohl sie zugleich zu Nvidias größten Kunden zählen. Google setzt in seinen Rechenzentren auf selbst entwickelte Tensor Processing Units (TPUs), die inzwischen auch von Partnern wie Anthropic genutzt werden. Amazon entwickelt eigene Prozessoren wie Trainium 3, die künftig auch bei OpenAI zum Einsatz kommen sollen. Parallel will OpenAI in Kooperation mit Broadcom eigene KI-Chips entwickeln. Microsoft hat mit Maia und Cobalt eigene KI‑Chips vorgestellt, während Meta bereits auf firmeneigene Beschleuniger wie den MTIA 300 setzt.

Diese In‑House‑Lösungen erreichen zwar nicht die absolute Leistungsfähigkeit universeller Nvidia‑GPUs, lassen sich jedoch präziser auf die jeweiligen KI‑Modelle zuschneiden, was sie oft effizienter macht. Gleichzeitig erhöhen die Konzerne damit ihre technologische Unabhängigkeit.

Trend 2: Inferenz verändert die Anforderungen an KI-Chips

Im KI-Computing vollzieht sich ein tiefgreifender Wandel. "KI ist inzwischen in der Lage, produktive Arbeit zu leisten – damit ist der Wendepunkt der Inferenz erreicht", sagte der Gründer und CEO von Nvidia, Jensen Huang, bei der GTC im März 2026 in San José. Gemeint ist der Kipppunkt, ab dem nicht mehr das Trainieren immer größerer Modelle, sondern deren Anwendung beispielsweise durch KI-Agenten zum dominanten Treiber für den Rechenbedarf wird.

"Jedes Mal, wenn KI denkt, handelt oder schlussfolgert, erzeugt sie Token – und führt Inferenz aus", so Jensen Huang. Klassische GPU sind für Inferenz nicht ideal, da sie einen hohen Energieverbrauch aufweisen und nicht über ausreichend nah angebundenen Speicher verfügen. Für Nvidia bedeutet dies, dass zahlreiche Wettbewerber die Chance sehen, bei der Inferenz anzugreifen und darüber Marktanteile zu gewinnen.

Comeback der CPU: Im KI-Boom lange im Hintergrund, erleben CPU (Prozessoren, die Rechenprozesse zentral steuern), eine Renaissance. Gerade bei Inferenz-Aufgaben für KI-Agenten spielen sie eine wichtige Rolle, etwa bei Orchestrierung oder Koordination. Viele Chiphersteller wie Intel und AMD bringen CPU auf den Markt, die für Inferenz optimiert sind. Für Aufsehen sorgte zuletzt der AGI‑CPU von Arm, der speziell für die Orchestrierung von KI‑Agenten entwickelt wurde.

Spezielle Inferenz-Chips: Eine wachsende Zahl von Unternehmen entwickelt anwendungsspezifische Prozessoren (ASICs), die gezielt für KI‑Inferenz optimiert sind. Dazu zählen etwa Amazons Inferentia‑Chips sowie auf Inferenz ausgerichtete TPUs von Google. Hinzu kommen Start-ups wie Cerebras, D-Matrix, Etched oder SambaNova die auf hochspezialisierte Chips für Inferenzaufgaben setzen.

Auch Nvidia reagiert auf diese Entwicklungen. Auf der GTC 2026 präsentierte der Konzern die Vera CPU, die gezielt für agentische KI‑Workloads und Orchestrierungsaufgaben optimiert ist. Zudem sicherte sich Nvidia die Lizenz für die Language‑Processing‑Unit‑Technologie (LPU) des Start-ups Groq, die speziell für KI‑Inferenz ausgelegt ist.

Trend 3: Auch Physical AI benötigt spezialisierte Chips

Ob autonome Autos, humanoide Roboter oder Digital Twins – physische KI ist ein rasantes Wachstumsfeld. Diese Anwendungen laufen vor allem auf kleinen, spezialisierten KI-Modellen, die extrem energieeffizient, latenzarm und echtzeitfähig arbeiten müssen.

Dies steht im engen Zusammenhang mit einem weiteren Trend: Edge AI.

Insbesondere physische KI verlagert sich zunehmend aus der Cloud auf Edge‑Geräte wie Fahrzeuge oder medizinische Systeme. Je nach Anwendung kommen dabei maßgeschneiderte Chips zum Einsatz – etwa für Echtzeit‑Sensorfusion und Entscheidungsfindung im autonomen Fahren oder für beschleunigte medizinische Bildgebung und Diagnostik im Gesundheitswesen.

Markt für KI-Chips stellt sich breiter auf

Die Veränderungen führen zu einer breiteren und stärker diversifizierten KI‑Chip‑Landschaft. GPUs bleiben weiterhin zentral, und Nvidia dürfte seine Vormachtstellung in diesem Segment behaupten. In den stark wachsenden Bereichen wie Inferenz und anwendungsspezifischen Chips hingegen dürften Wettbewerber zunehmend bedeutende Marktanteile gewinnen. Einige Analysten schätzen, dass Nividias Marktanteil hier gegen Ende des Jahrzehnts nur bei 20 bis 30 Prozent liegen könnte.

Was die Entwicklung für deutsche Unternehmen bedeutet

Der erwartete Siegeszug anwendungsspezifischer Chips fragmentiert die Halbleiterindustrie. An die Stelle weniger Standard-Chips tritt eine wachsende Vielfalt spezialisierter Lösungen. Das macht das Ökosystem heterogener, bringt neue Akteure ins Spiel und eröffnet Zulieferern entlang der Wertschöpfungskette zusätzliche Chancen.

- Halbleiterindustrie kann direkt profitieren: Infineon ist stark bei kundenspezifischen Automotive- und Power-Chips, Leistungselektronik für KI-Rechenzentren sowie Microcontrollern; Bosch bei sensornahen KI-Anwendungen im Fahrzeug und der Industrie. X-Fab in Erfurt als Foundry und Elmos als Designer sind bei ASIC ebenfalls gut positioniert.

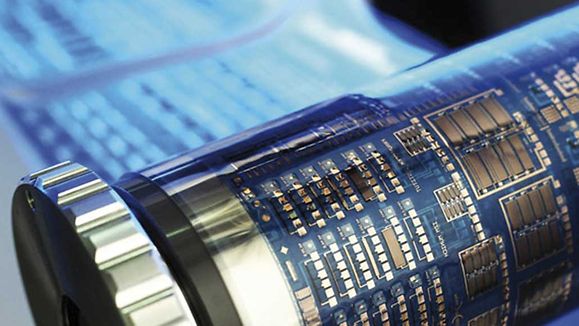

- Advanced-Packaging eröffnet Zulieferchancen: Bei KI-Inferenz greifen Chips ständig auf gelerntes Wissen zu, das im Speicher liegt. Auch bei Edge AI müssen Bauteile eng zusammenarbeiten. Deshalb werden bei anwendungsspezifischen Chips wie ASIC Leistungsgewinne zunehmend dadurch erzielt, dass Rechenlogik und Speicher räumlich enger integriert werden – etwa durch Chiplets, 2,5D-Integration, 3D‑Stacking und High‑Bandwidth‑Memory (HBM). Ein wachsender Teil der Wertschöpfung verlagert sich damit ins Advanced-Packaging, also in das Backend. Dies ist eine Stärke des deutschen Mittelstandes, da es auf Präzession, Spezialmaschinen und anspruchsvolle Materialen ankommt. Ein Beispiel ist der Maschinenbauer Suss MicroTech, der Beschichtungs- und Prozessanlagen für Advanced-Packaging liefert. Darüber hinaus ergeben sich für mittelständische Zulieferer Chancen durch die steigende Fertigungskomplexität beim Advanced-Packaging – etwa bei Ventilen, Pumpen, Filtern, Quarz‑, Keramik‑ und Grafitbauteilen sowie Präzisionsoptiken.

- Steigender Bedarf bei präziser Messtechnik: Die Spezialisierung von Chips geht mit geringerer Standardisierung und individuelleren Fertigungsprozessen einher. Dies erhöht den Prüf‑und Inspektionsaufwand. Spezialisierte Chips für Edge-AI-Anwendungen müssen zudem extrem zuverlässig funktionieren, da sie in sicherheitskritischen Bereichen wie Autos oder Medizintechnik eingesetzt werden. Beides erhöht den Bedarf an hochpräziser Messtechnik.

- Hochreine Materialen für Chips: Mit dem Wachstum spezialisierter Chips steigt auch die Nachfrage nach hochwertigen Materialen und Chemikalien, die für deren Herstellung benötigt werden. Dabei kommt es insbesondere auf extreme Reinheit und stabile Eigenschaften bei hohen Temperaturen an. In diesem Bereich sind unter anderem Merck aus Darmstadt und Wacker Chemie als Anbieter von Spezialmaterialien tätig. Atotech aus Berlin ist ein Spezialist für nasschemische Verfahrens- und Anlagenlösungen für das Advanced-Packaging.